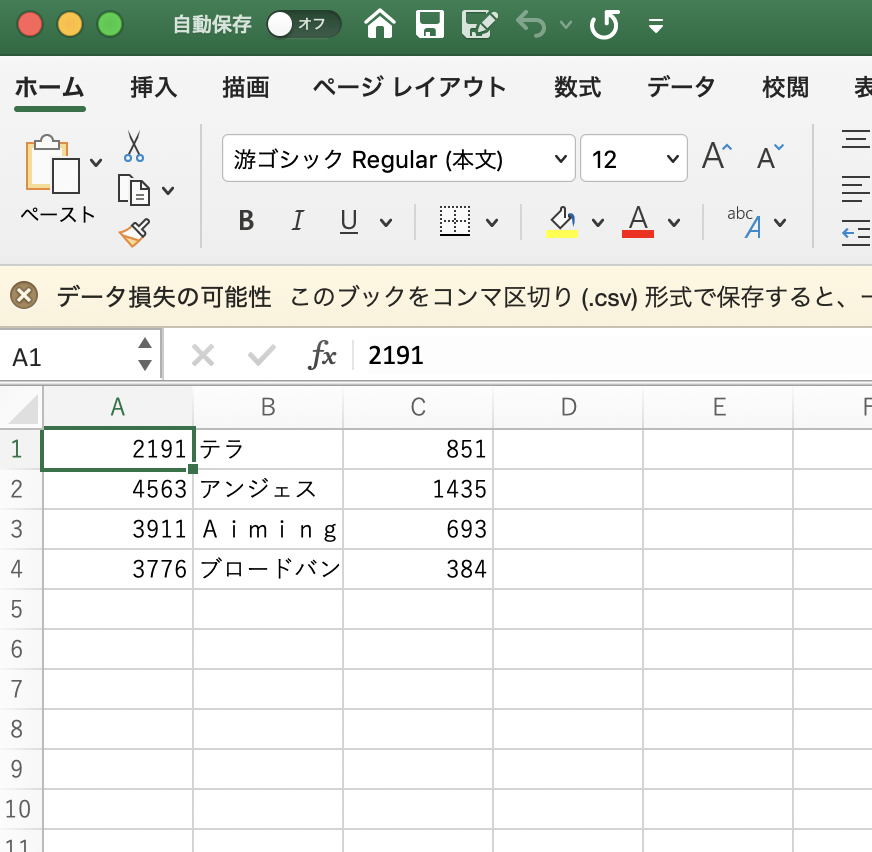

免許証画像は以下を使用する

tesseract_layoutの値を1から10まで変更して検証する

### tesseract_layout=1

$ python3 main.py

(mm| 日 本 花 子 軌和61年 5月

]1 日生

人誠| 東京都生代田区霞が関2ー 1一2

け| 令和01年05807H 12345

### tesseract_layout=2

$ python3 main.py

Traceback (most recent call last):

File “main.py”, line 9, in

txt = tools[0].image_to_string(

File “/home/vagrant/.local/lib/python3.8/site-packages/pyocr/tesseract.py”, line 386, in image_to_string

raise TesseractError(

pyocr.error.TesseractError: (-1, “Unable to find output file (tested [‘/tmp/tmpuiijvfgx/output.txt’])”)

### tesseract_layout=3

$ python3 main.py

(mm| 日 本 花 子 軌和61年 5月

]1 日生

人誠| 東京都生代田区霞が関2ー 1一2

信和01年05』07H 12345

### tesseract_layout=4

$ python3 main.py

(名| 日 本 花 子 昭和61年 5月 1日生

人誠| 東京都生代田区霞が関2ー 1一2

交付| 令和O1年05』07H 12345

2024箇(06$06有O1Hまで勧

%の 眼鏡等

条件等

見 本

き引第 012345678900 号

0

を人 ト民捧人構誠還| 〇〇OOO

=層衣2908』018導笛にに回較固 ま中

### tesseract_layout=5

$ python3 main.py

| |

に 5

中 M

加 9

9

避 Ok

ら 呈較っ

守 CN OS

| 較 抽| |睦旧旧計員

ー|。居 則遇|

| mp

– 還 RE 逢遇

| | 国~園 必g式還

玲|上 O、 は半較|

陸中 8

| 錠 [壮 加|

| 略叶RS sss

是 陸中

| 還|二 地

| 層間 ら5 8さき

EE ーーベ

[es = 絆|還> 証庄計

首日 EHP

### tesseract_layout=6

$ python3 main.py

(信所| 東京都寺代田区霞が関2-1一2

$和01キ05』07B 12345

天の 眼鏡等 に

条件等

見本 *

*引012345678900 呈 叶

に天上1 5404』01H話司にに放還 ま

に17108801間 汗天市生天 )

にafW29*08801 只間四時間 Sgms 583

### tesseract_layout=7

$ python3 main.py

で 敵 ーー an

### tesseract_layout=8

$ python3 main.py

で 敵

### tesseract_layout=9

$ python3 main.py

|

### tesseract_layout=10

$ python3 main.py

er

### 結論

tesseract_layout=4, lang=’jpn’ が一番まともな気がするけど、

なんでだろう?

きちんと精度高く読み取るにはGoogleのVison APIで実装するっぽいな…